Introducción Las cadenas de markov son modelos probabilísticos que se usan para predecir la evolución y el comportamiento a corto y a largo plazo de determinados. - ppt descargar

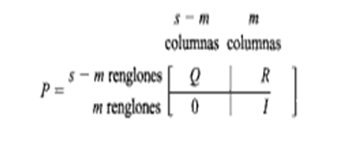

Clasificación de estados de una Cadena de Markov - Definición de cadena irreducible, estados recurrentes, transcientes, periódicos y aperiódicos